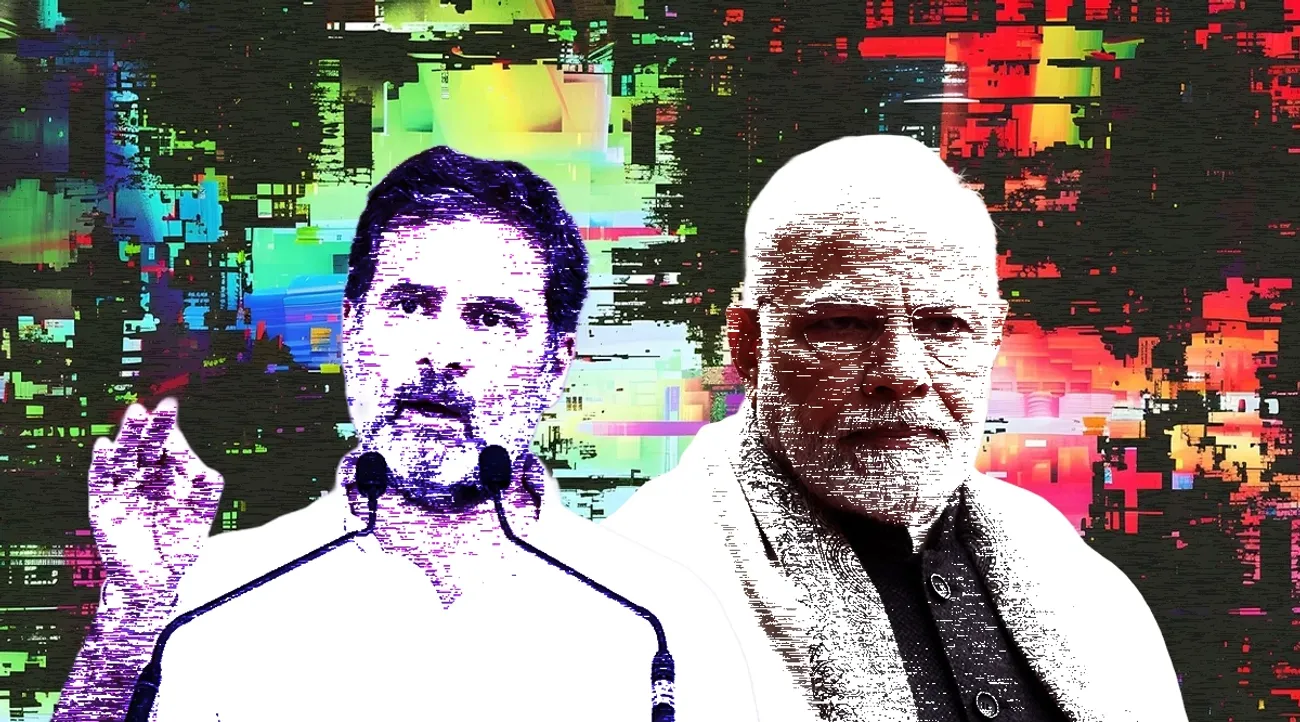

2024-ലെ ലോക്സഭാ തിരഞ്ഞെടുപ്പ്.

ശ്രദ്ധിക്കുക, എൺപതുകളോ തൊണ്ണൂറുകളോ അല്ല കാലം. 2024 ആണ്. ബാലറ്റ് പേപ്പറുകളുടെയോ ചൂണ്ടുവിരലിൽ പുരളുന്ന നീലമഷിയുടെയോ ‘പഴയ’ ഇന്ത്യയല്ല ഇത്. ഡീപ്ഫേക്കിന്റെയും എ.ഐയുടെയും ഇന്ത്യ,

പുതിയ ഇന്ത്യ.

•

ബോളിവുഡ് നടൻ അമീർഖാൻ ബി.ജെ.പിയെയും കേന്ദ്രസർക്കാരിനെയും പരിഹസിക്കുന്ന ഒരു വീഡിയോ വൈറലായത് കഴിഞ്ഞ ദിവസമാണ്. ഇന്ത്യൻ പൗരരുടെ ബാങ്ക് അക്കൗണ്ടുകളിലേക്ക് 15 ലക്ഷം രൂപ നിക്ഷേപിക്കുമെന്ന കഴിഞ്ഞ തിരഞ്ഞെടുപ്പ് കാലത്തെ ബി.ജെ.പിയുടെയും നരേന്ദ്ര മോദിയുടെയും വാഗ്ദാനത്തെ പരിഹസിക്കുകയാണ് വീഡിയോയിൽ അമീർഖാൻ. ബി.ജെ.പിയെ പരിഹസിക്കുന്നത് കൂടാതെ കോൺഗ്രസിന് വോട്ട് ചെയ്യണമെന്നും കോൺഗ്രസ് സ്ഥാനാർത്ഥികളെ പിന്തുണയ്ക്കണമെന്നും അമീർഖാൻ ആവശ്യപ്പെടുന്നുണ്ട്. എന്നാൽ വീഡിയോ തന്റെതല്ലെന്നും താൻ അങ്ങനെ അഭിപ്രായപ്പെട്ടിട്ടില്ലെന്നും അമീർഖാൻ തന്നെ പിന്നീട് വ്യക്തമാക്കി.

ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ സഹായത്തോടെ തയ്യാറാക്കിയ ഒരു വ്യാജ ഡീപ്ഫേക്ക് വീഡിയോ ആയിരുന്നു ഇത്. യഥാർത്ഥ വീഡിയോയിൽ നിന്നുള്ള ശബ്ദം അടർത്തിമാറ്റി അമീറിന്റേത് എന്ന് തോന്നുംവിധം ഡീപ്ഫേക്ക് സാങ്കേതികവിദ്യ ഉപയോഗിച്ച് ശബ്ദം പുനഃക്രമീകരിക്കുകയായിരുന്നു. നടന്റെ സെലിബ്രിറ്റി സ്റ്റാറ്റസ് മുതലെടുത്ത് വോട്ട് പിടിക്കുകയായിരുന്നു ലക്ഷ്യം. സമാന രീതിയിൽ, ബോളിവുഡ് നടൻ രൺവീർ സിംഗ് കോൺഗ്രസിന് വോട്ട് അഭ്യർത്ഥിക്കുന്ന മറ്റൊരു ഡീപ്ഫേക്ക് വീഡിയോയും പ്രചരിക്കുന്നുണ്ട്. വീഡിയോ തന്റേതല്ലെന്ന് കാണിച്ച് രൺവീർ സിംഗും രംഗത്തെത്തിയിരുന്നെങ്കിലും ഇതിനകം ലക്ഷക്കണക്കിന് ആളുകൾ വീഡിയോ കണ്ടുകഴിഞ്ഞു.

ഉത്തരാഖണ്ഡിൽ നിന്നുള്ള കോൺഗ്രസ് വക്താവ്, സുജാത പോൾ രൺവീർ സിംഗിന്റെ വീഡിയോ ഏപ്രിൽ 17-ന് തന്റെ എക്സ് അക്കൗണ്ടിൽ പങ്കുവെക്കുകയും ചെയ്തിരുന്നു. 16,000-ലധികം ഫോളോവേഴ്സുള്ള ഇവരുടെ എക്സ് അക്കൗണ്ടിൽ പോസ്റ്റ് ചെയ്യപ്പെട്ട ഈ ഡീപ് ഫേക്ക് വീഡിയോ അന്ന് ഉച്ചയോടെ 2900 തവണ റിഷെയർ ചെയ്യപ്പെട്ടു. ആകെ 43800 ആളുകൾ വീഡിയോ കണ്ടു, 8700 ലൈക്കും കിട്ടി.

'ബിവേർ ഓഫ് ഡീപ് ഫേക്ക്' എന്നാണ് സംഭവത്തിൽരൺവീർ സിംഗ് പ്രതികരിച്ചത്. വീഡിയോ ഡീപ്ഫേക്ക് ആണെന്നറിഞ്ഞിട്ടും അത് നീക്കം ചെയ്യാൻ തോന്നിയില്ലെന്നാണ് സുജാത പോൾ പിന്നീട് റോയിട്ടേഴ്സിനോട് പറഞ്ഞത്. വീഡിയോ നീക്കം ചെയ്തെന്ന് ഫേസ്ബുക്ക് അറിയിച്ചെങ്കിലും രൺവീറിന്റെയും അമീറിന്റെയും വീഡിയോകൾ ഫെയ്സബുക്കിൽ കണ്ടതും പതിനായിരക്കണക്കിന് ആളുകളാണ്.

18ാം ലോകസഭാ തിരഞ്ഞെടുപ്പ് ആദ്യഘട്ടം പൂർത്തിയാക്കിയിരിക്കെ ഡീപ് ഫേക്കിന്റെ ഈ കഥകൾ വല്ലാതെ ഭയപ്പെടുത്തുന്നതാണ്. തിരഞ്ഞെടുപ്പിൽ നിർമിതബുദ്ധി എങ്ങനെയൊക്കെ ഉപയോഗിക്കപ്പെടുന്നു എന്നതിന്റെ ചെറിയൊരു ഉദാഹരണം മാത്രമാണിത്. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ ദുരുപയോഗം, പ്രത്യേകിച്ച് തിരഞ്ഞെടുപ്പ് പോലൊരു ജനാധിപത്യ പ്രക്രിയയെ എങ്ങനെയൊക്കെ ബാധിക്കുമെന്ന വിഷയം ഇതോടെ വീണ്ടും ചർച്ചയാവുകയാണ്.

എ.ഐ ഉപയോഗിച്ച് തയ്യാറാക്കുന്ന കൃത്രിമ വീഡിയോകളും, മറ്റ് എ.ഐ സംവിധാനങ്ങളും തെറ്റായ രീതിയിൽ തിരഞ്ഞെടുപ്പിനുപയോഗിക്കുന്നത് ഇന്ത്യയിൽ ഇതാദ്യമായൊന്നുമല്ല. 2023 നവംബർ 30ന് തെലങ്കാനയിൽ തിരഞ്ഞെടുപ്പ് ദിവസം, വോട്ട് ചെയ്യാൻ വരിനിൽക്കുന്നവർക്ക് വാട്ട്സാപ്പിൽ ഒരു വീഡിയോ മെസേജ് കിട്ടി. അന്നത്തെ മുഖ്യമന്ത്രി കെ. ചന്ദ്രശേഖര റാവുവിന്റെ മകനും ഭാരതീയ രാഷ്ട്ര സമിതി (ബി.ആർ.എസ്) നേതാവുമായ കെ.ടി. രാമറാവു കോൺഗ്രസിന് വോട്ട് ചെയ്യാൻ ആഹ്വാനം ചെയ്യുന്ന ദൃശ്യങ്ങളായിരുന്നു വീഡിയോയിൽ. ഡീപ് ഫേക്കിന്റെ സഹായത്തോടെ വ്യാജമായി ഉണ്ടാക്കിയതായിരുന്നു വീഡിയോ. കോൺഗ്രസിന്റെ തന്നെ എക്സ് അക്കൗണ്ടുകൾ അന്ന് അത് റീ പോസ്റ്റും ചെയ്തു. കോൺഗ്രസിന്റെ അനൗദ്യോഗിക വാട്ട്സാപ്പ് ഗ്രൂപ്പുകളിലും പ്രചരിച്ച വീഡിയോ 5 ലക്ഷത്തിലധികം ആളുകളാണ് കണ്ടത്. തെരഞ്ഞെടുപ്പ് നടന്നുകൊണ്ടിരിക്കുമ്പോഴാണ് വീഡിയോ അളുകളിലേക്ക് എത്തിയതെന്നതിനാൽ വിശദീകരണം നൽകാൻ കഴിഞ്ഞില്ലെന്ന് ബി.ആർ.എസ് വൃത്തങ്ങൾ അറിയിച്ചിരുന്നു.

ഒരു സാധാരണ വോട്ടർക്ക് ഇതിന്റെ സത്യാവസ്ഥ എന്തെന്ന് മനസ്സിലാക്കാൻ പെട്ടെന്ന് കഴിഞ്ഞെന്ന് വരില്ല. വോട്ടർ പെട്ടന്ന് സ്വാധീനിക്കപ്പെട്ടന്നും വരും. അവസാന ഓവറിൽ കളി തിരിക്കാനുള്ള ഒരു പന്ത് - അങ്ങനെയാണ് പലരും ആർട്ടിഫിഷ്യൽ ഇൻലിജൻസിന്റെ ഈ സാധ്യതകളെ ഉപയോഗിക്കുന്നത്.

സമാന രീതിയിൽ 2020-ൽ അന്നത്തെ ബി.ജെ.പി ഡൽഹി ഘടകം പ്രസിഡന്റും ഗായകനുമായ മനോജ് തിവാരി വ്യത്യസ്ത ഭാഷകളിൽ പ്രചാരണം നടത്തുന്ന ഒരു ഡീപ്ഫേക്ക് വീഡിയോയും വൈറലായിരുന്നു (മനോജ് തിവാരി ഇത്തവണത്തെ ലോകസഭാ തിരഞ്ഞെടുപ്പിൽ നോർത്ത് ഈസ്റ്റ് ഡെൽഹിയിലെ ബി.ജെ.പി സ്ഥാനാർത്ഥിയാണ്). ഡീപ് ഫേക്ക് വീഡിയോകൾ രാഷ്ട്രീയത്തിൽ ഉപയോഗിക്കപ്പെടുന്നതിന് രാജ്യം ആദ്യമായി സാക്ഷ്യം വഹിച്ചത് അന്നായിരുന്നു. രണ്ട് കൃത്രിമ വീഡിയോകളായിരുന്നു അന്ന് ബി.ജെ.പി പ്രചരിപ്പിച്ചത്. ഒരു വീഡിയോയിൽ ഇംഗ്ലീഷിൽ സംസാരിക്കുന്ന മനോജ് തിവാരി മറ്റൊന്നിൽ ഹര്യാൻവി ഭാഷയിലാണ് സംസാരിച്ചിരുന്നത്. ഡൽഹിയിലും ഹരിയാനയിലും പ്രചാരത്തിലുള്ള ഹിന്ദിയുടെ ഒരു വകഭേദമാണ് ഹര്യൻവി. 2011-ലെ സെൻസസ് പ്രകാരം ഏകദേശം ഒരുകോടി ആളുകൾ തങ്ങളുടെ പ്രഥമ ഭാഷയായി ഹര്യാൻവി ഭാഷ ഉപയോഗിക്കുന്നുണ്ടെന്നാണ് കണക്കുകൾ. ദംഗൽ, സുൽത്താൻ തുടങ്ങി ബോക്സ് ഓഫീസിൽ കളക്ഷൻ റെക്കോർഡുകൾ ഭേദിച്ച ബോളിവുഡ് സിനിമകളിൽ ഉപയോഗിച്ചിരുന്നത് ഹര്യാൻവിയായിരുന്നു എന്നതും ശ്രദ്ധേയമാണ്. താരതമ്യേന ന്യൂനപക്ഷമായ ഹര്യാൻവി ഭാഷക്കാർക്കിടയിൽ മേൽക്കൈ ഉണ്ടാക്കിയെടുക്കാൻ ഇതിലൂടെ മനോജ് തിവാരിക്ക് കഴിഞ്ഞിരുന്നു. എന്നാൽ ഭാഷാന്യൂനപക്ഷങ്ങൾക്കിടയിലും പ്രചാരണം നടത്താൻ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിനെ പോസിറ്റീവായി ഉപയോഗിക്കുകയായിരുന്നു എന്നായിരുന്നു അന്ന് ബി.ജെ.പി വാദിച്ചത്.

എ.ഐ ഉപയോഗിച്ച് തെറ്റായ വിവരങ്ങൾ പ്രചരിപ്പിക്കാൻ കഴിയുമെന്നത്, പ്രത്യേകിച്ച് തിരഞ്ഞെടുപ്പ് കാലങ്ങളിൽ എ.ഐ ദുരുപയോഗം ചെയ്യപ്പെട്ടേക്കാമെന്നത് അന്ന് തന്നെ ചൂടേറിയ ചർച്ചകൾക്ക് വഴിവെച്ചിരുന്നു. 2014-ലെ ലോകസഭാ തെരഞ്ഞെടുപ്പിൽ, ഓരോ വോട്ടർമാരുടെയും പേര് പരമാർശിച്ചുകൊണ്ടുള്ള പ്രത്യേകം പ്രത്യേകം കൃത്രിമ വീഡിയോ സന്ദേശങ്ങൾ പ്രചരിപ്പിക്കാനും ബി.ജെ.പിക്ക് കഴിഞ്ഞിരുന്നു. വോട്ടർമാരെ എളുപ്പത്തിൽ ടാർഗറ്റ് ചെയ്യാൻ ഇത് ബി.ജെ.പിക്ക് തുണയായിരുന്നു. രാഷ്ട്രീയത്തിലേക്ക് സാങ്കേതികവിദ്യയെ സമന്വയിപ്പിച്ച ബി.ജെ.പിയുടെ അതിവിദഗ്ധമായ ഒരു പരീക്ഷണമായിരുന്നു ഇത്.

മറ്റൊന്ന്, 2023-ൽ വാരാണാസിയിൽ നടന്ന കാശി തമിഴ് സംഗമത്തിലെ പ്രധാനമന്ത്രി മോദിയുടെ പ്രസംഗമാണ്. 2023 ഡിസംബർ 17 ന് നടന്ന ഉദ്ഘാടന ചടങ്ങിൽ മോദി ഹിന്ദിയിൽ പ്രസംഗിച്ചതത്രയും കേൾവിക്കാർ കേട്ടത് തമിഴിലായിരുന്നു. ഭാഷിണി എന്ന് പേരിട്ടിരുന്ന തത്സമയ എ.ഐ പരിഭാഷാ സംവിധാനമായിരുന്നു അന്ന് മോദി ഉപയോഗിച്ചത്. കേൾവിക്കാരെ അവരുടെ ഭാഷയിൽ തന്നെ അഡ്രസ്സ് ചെയ്യാൻ കഴിഞ്ഞത് മോദിക്ക് ചെറുതല്ലാത്ത ജനപ്രീതി ഉണ്ടാക്കിക്കെടുക്കുകയും ചെയ്തിരുന്നു. ഭാഷിണി വിവർത്തനം ചെയ്ത മോദിയുടെ പ്രസംഗം പിന്നീട് ബി.ജെ.പിയുടെ സോഷ്യൽ മീഡിയ പ്ലാറ്റ്ഫോമുകളിലും സംപ്രേക്ഷണം ചെയ്തിരുന്നു. പ്രധാനമന്ത്രി അവരുടെ ഭാഷ സംസാരിക്കുന്നത് കേട്ടിട്ടില്ലാത്ത ആയിരക്കണക്കിന് തമിഴ്നാട്ടുകാരാണ് അത് സോഷ്യൽ മീഡിയയിൽ കണ്ടത്. പിന്നീട് കന്നഡ, ബംഗാളി, തെലുങ്ക്, പഞ്ചാബി, മറാത്തി, ഒഡിയ, മലയാളം ഭാഷകളിലേക്കും ഭാഷിണി ഉപയോഗിച്ച് മോദിയുടെ പ്രസംഗം വിവർത്തനം ചെയ്ത് പ്രചരിപ്പിച്ചിരുന്നു. ഭാഷയുടെ അതിർവരമ്പുകളെ ഭേദിച്ചുകൊണ്ട് തെക്കേ ഇന്ത്യയിലേക്കും തങ്ങളുടെ രാഷ്ട്രീയ അജണ്ടകൾ വ്യാപിപ്പിക്കാനുള്ള ബി.ജെ.പിയുടെയും കേന്ദ്രസർക്കാരിന്റെയും രാഷ്ട്രീയ പദ്ധതിയായാണ് ഈ എ.ഐ കളി വ്യാഖ്യാനിക്കപ്പെട്ടത്.

വിവിധ പ്രദേശങ്ങളിലുള്ള, വിവിധ ഭാഷകൾ സംസാരിക്കുന്ന ജനങ്ങളുമായി ബന്ധപ്പെടാനുള്ള ബി.ജെ.പിയുടെ രാഷ്ട്രീയ ശ്രമങ്ങൾക്ക് അഭിനന്ദനങ്ങളും ലഭിച്ചിരുന്നെങ്കിലും വിവർത്തനങ്ങളുടെ ആധികാരികതയെക്കുറിച്ചും പ്രസംഗങ്ങളുടെയും മറ്റും തെറ്റായ വ്യാഖ്യാനത്തിനുള്ള സാധ്യതയെക്കുറിച്ചും അന്ന തന്നെ ആശങ്കകളുയരുകയും ചെയ്തിരുന്നു. നിർമിത ബുദ്ധി എന്നാണ് പേരെങ്കിലും പഠിക്കാൻ കൊടുക്കുന്ന ഡാറ്റയിലെ മാത്രം വിവരങ്ങൾ വിശകലനം ചെയ്ത് കാര്യങ്ങളിൽ തിരുമാനമെടുക്കാൻ കഴിയുന്നവയാണ് എ.ഐ സംവിധാനങ്ങൾ. അതായത് പഠിക്കാൻ കൊടുക്കുന്ന ഡാറ്റ എങ്ങനെയുള്ളതാണ് എന്നതിനെ ആശ്രയിച്ചിരിക്കും എ.ഐ തരുന്ന വിവരങ്ങളു. തെറ്റായ ഡാറ്റകൾ പഠിച്ചിട്ടുള്ള എ.ഐ ആണെങ്കിൽ നിങ്ങൾക്ക് കിട്ടുന്ന വിവരവും അത്ര തന്നെ തെറ്റായിരിക്കും. ഇതാണ് രാഷ്ട്രീയത്തിൽ എ.ഐ ഉപയോഗിക്കുമ്പോഴുള്ള എറ്റവും വലിയ വെല്ലുവിളികളിലൊന്ന്. പ്രത്യേകിച്ച് പ്രചാരണങ്ങളിൽ. തെറ്റായ വിവരങ്ങളാണ് നൽകപ്പെടുന്നതെങ്കിൽ ചിലപ്പോൾ വിദ്വേഷ പ്രസംഗംവും, വംശീയ പരാമർശങ്ങളും പോലും പച്ചയ്ക്ക് പറഞ്ഞുകളയും എ.ഐ. ഇപ്പോഴും പ്രചാരണത്തിൽ ഡിജിറ്റൽ ഉപകരണങ്ങൾ പ്രയോജനപ്പെടുത്തുന്നതിൽ മുൻപന്തിയിലുള്ളത് ബി.ജെ.പിയാണ് എന്നത്കൂടി കണക്കിലെടുക്കുമ്പോഴാണ് ഇതിന്റെ ഗൗരവം മനസ്സിലാവുക.

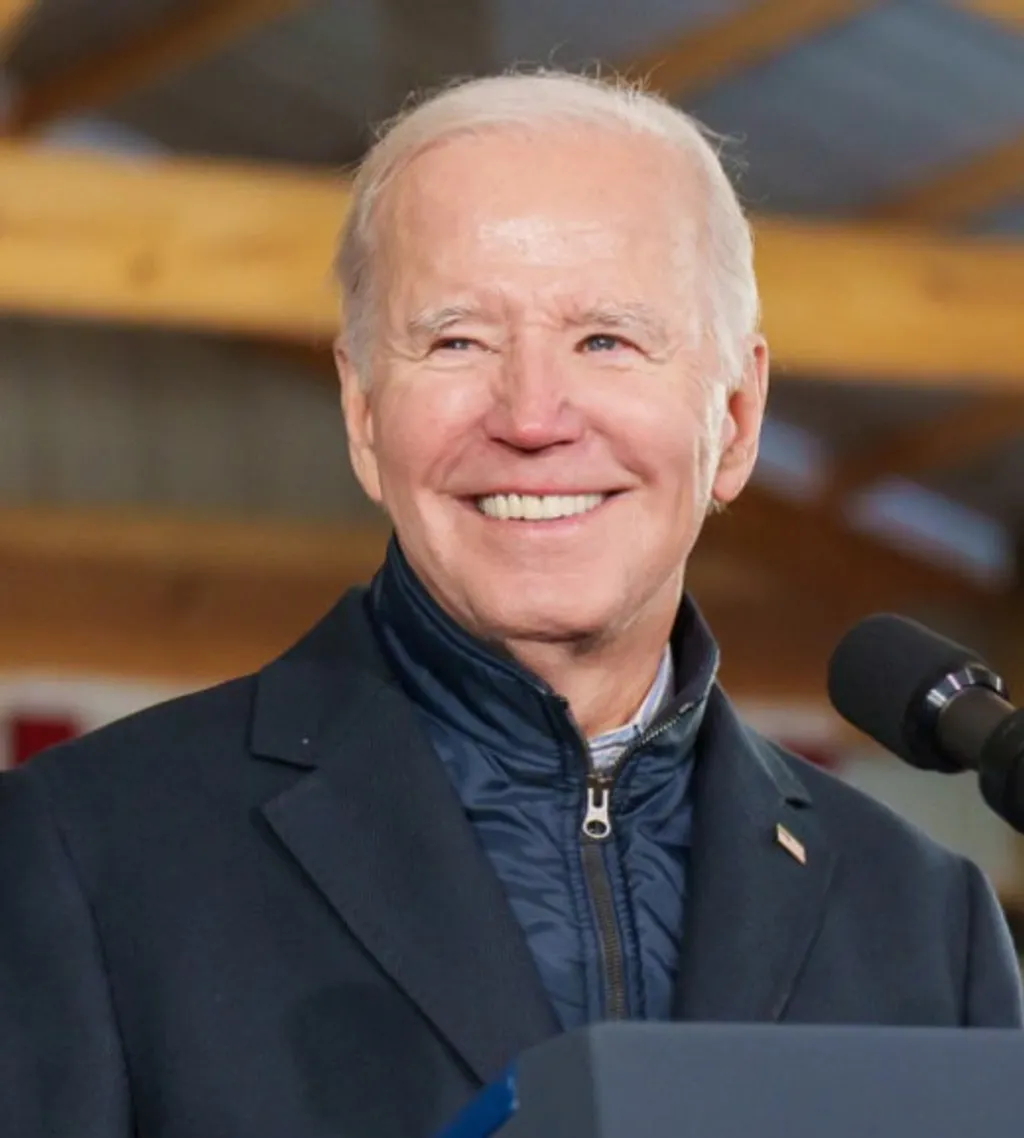

ഇന്ത്യയിൽ മാത്രമല്ല അമേരിക്ക പോലുള്ള ഡെവലപ്ഡ് രാജ്യങ്ങളിൽ പോലും തിരഞ്ഞെടുപ്പ് പോലുള്ള ജനാധിപത്യപ്രക്രിയയിൽ എ.ഐ എത്രമാത്രം ദുരുപയോഗം ചെയ്യപ്പെടുന്നു എന്നതിന്റെ ഉദാഹരണമായിരുന്നു കഴിഞ്ഞ ജനുവരിയിൽ പ്രസിഡന്റ് ബൈഡന്റെ സ്വരത്തിൽ ആളുകൾക്ക് ലഭിച്ച എ.ഐ കോളുകൾ. റിപ്പബ്ലിക്കൻ പാർട്ടിയുടെ പ്രസിഡന്റ് സ്ഥാനാർഥിയെ തെരഞ്ഞെടുക്കാനുള്ള ന്യൂഹാംഷെയർ പ്രൈമറിയിൽ ആരും വോട്ട് ചെയ്യരുതെന്ന് ആഹ്വാനം ചെയ്തുകൊണ്ടുള്ള ബൈഡന്റെ സന്ദേശമാണ് നിരവധി വോട്ടർമാർക്ക് ലഭിച്ചത്. ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് ഉപയോഗിച്ച് ബൈഡന്റെ ശബ്ദം അനുകരിച്ചുള്ള റോബോ കോളായിരുന്നു അത്. വോട്ടെടുപ്പിൽ നിന്ന് ജനങ്ങളോട് വിട്ടുനിൽക്കാൻ ആവശ്യപ്പെട്ട 'ബൈഡന്റെ വ്യാജ ശബ്ദം' ആ വോട്ടുകൾ നവംബറിൽ നടക്കുന്ന പ്രസിഡന്റ് തെരഞ്ഞെടുപ്പിലേക്കായി സൂക്ഷിക്കാനാണ് ആവശ്യപ്പെട്ടത്. ബൈഡൻ പതിവായി ഉപയോഗിക്കുന്ന വാചകങ്ങളടക്കം കടമെടുത്തുകൊണ്ടായിരുന്നു അദ്ദേഹത്തിന്റെ വ്യാജ ശബ്ദം സൃഷ്ടിച്ചതെന്നതും എ.ഐ എത്രമാത്രം ശക്തവും സൂക്ഷമവുമാണെന്ന് കാണിക്കന്നതായിരുന്നു.

ഫെയ്സ്ബുക്ക് ഉപയോക്താക്കളുടെ വിവരങ്ങൾ ചോർത്തി കേംബ്രിഡ്ജ് അനലറ്റിക്ക എന്ന പൊളിറ്റിക്കൽ കൺസൾട്ടിംഗ് ഫേം ഡാറ്റാ മോഷണം നടത്തിയതും 2016- ലെ അമേരിക്കൻ പ്രസിഡന്റ് തിരഞ്ഞെടുപ്പ് കാലത്തായിരുന്നു. അതിനും രണ്ട് വർഷങ്ങൾക്കിപ്പുറം മധ്യ ആഫ്രിക്കൻ രാജ്യമായ ഗാബോണിലെ തിരഞ്ഞെടുപ്പ് നടക്കവേ പ്രസിഡന്റ് അലി ബോംഗൊയുടെ ഡീപ്പ് ഫെയ്ക്ക് വീഡിയോ വൈറലായതും വലിയ കോലാഹലങ്ങൾ സ്യഷ്ടിച്ചിരുന്നു.

2019-ലെ ലോകസഭാ തിരഞ്ഞെടുപ്പ് മുതൽ മുഖ്യധാരയിലുള്ളതും അല്ലാത്തതുമായ എല്ലാ രാഷ്ട്രീയ പാർട്ടികളും സോഷ്യൽ മീഡിയ വഴിയുള്ള പ്രചാരണങ്ങൾക്ക് വൻ പ്രാധാന്യമാണ് നൽകിയത്. 2019 തിരഞ്ഞെടുപ്പിന് സോഷ്യൽ മീഡിയാ ഇലക്ഷൻ എന്ന പേര് പോലും ലഭിച്ചിരുന്നു. 18ാം ലോകസഭയിലേക്ക് നടന്നുകൊണ്ടിരിക്കുന്ന തിരഞ്ഞെടുപ്പിലും പ്രചാരണത്തിലും പൊളിറ്റിക്കൽ സ്ട്രാറ്റജി തിരുമാനിക്കുന്നതിലുമെല്ലാം എ.ഐയുടെ പ്രാധാന്യം വർദ്ധിച്ചു വരികയാണ്. ആറ് ആഴ്ച്ചകളിലും ഏഴ് ഘട്ടങ്ങളിലുമായി നീണ്ടുനിൽക്കുന്ന 18ാം ലോകസഭാ തിരഞ്ഞെടുപ്പ് ലോകത്തെ എറ്റവും കൂടുതൽ സമ്മദിദായകർ തങ്ങളുടെ വോട്ട് രേഖപ്പെടുത്താനെത്തുന്ന തിരഞ്ഞെടുപ്പാണ്. പ്രചാരണത്തിൽ സോഷ്യൽ മീഡിയാ പ്ലാറ്റ്ഫോമുകൾക്ക് വലിയ പ്രാധാന്യമുണ്ടെന്ന് മനസ്സിലാക്കിയതോടെ കണ്ടെന്റ് ക്രിയേഷനുകളുൾപ്പടെയുള്ള കാര്യങ്ങൾക്ക് വലിയ പ്രാധാന്യം കൊടുക്കുന്നുമുണ്ട് രാഷ്ട്രീയ പാർട്ടികൾ. പലപ്പോഴും ഒരു മഹാറാലിയോ റോഡ്ഷോയോ സംഘടിപ്പിക്കുന്നതിനേക്കാൾ ഗുണം ചെയ്യുന്നുണ്ട് ഇത് എന്ന് രാഷട്രീയ പാർട്ടികൾ തിരിച്ചറിഞ്ഞു കഴിഞ്ഞു.

വോട്ടർമാരെ മാത്രമല്ല, സ്ഥാനാർത്ഥികൾക്കും എ.ഐ സംവിധാനങ്ങൾ ഉപയോഗിച്ച് ഭീഷണിസന്ദേശങ്ങൾ ലഭിക്കാറുണ്ട്. വ്യാജ ഓഡിയോകൾ അഴിമതിക്കേസുകളിലും മറ്റും തെളിവായിപ്പോലും ചിലപ്പോൾ അവതരിപ്പിക്കപ്പെടും.

പൊളിറ്റിക്കൽ ക്യാമ്പയിനറും കമ്യൂണിക്കേഷൻ സ്പെഷ്യലിസ്റ്റുമായ സാഗർ വിഷ്ണോയിയുടെ അഭിപ്രായത്തിൽ, 'എ.ഐയെ തിരഞ്ഞെടുപ്പ് പ്രചാരണങ്ങളിൽ ഉപയോഗിക്കുന്നതുകൊണ്ട് ഗുണങ്ങളും പലതാണ്. 'ചെലവ് ഗണ്യമായി കുറയ്ക്കുന്നതോടൊപ്പം സമയം ലാഭിക്കാനും കാര്യക്ഷമത വർദ്ധിപ്പിക്കാനും എ.ഐക്ക് കഴിയും. മുമ്പ് രാഷ്ട്രീയ പാർട്ടികളും മറ്റും മാസങ്ങൾ സമയമെടുത്ത് തയ്യാറാക്കിയിരുന്ന സർവേകളും മറ്റും എ.ഐ ഉപയോഗിച്ച് ദിവസങ്ങൾ കൊണ്ട് പൂർത്തിയാക്കാൻ കഴിയും.' എന്നാൽ തിരഞ്ഞെടുപ്പ് പ്രക്രിയ കൂടുതൽ കാര്യക്ഷമമാക്കുന്നതിന് എ.ഐ വലിയ സംഭാവന നൽകുമെന്ന് പ്രതീക്ഷിക്കുമ്പോൾ തന്നെ എ.ഐ ജനാധിപത്യത്തിന് ഭീഷണിയായിത്തീരുമോ എന്ന ആശങ്കയും ഇപ്പോഴും നിലനിൽക്കുന്നു.

ഇന്ത്യയിൽ ഏകദേശം 750 ബില്യൺ ആളുകൾക്ക് ഇന്റർനെറ്റ് ആക്സസ് ഉണ്ടെന്നാണ് കണക്കുകൾ. ഒരു ശരാശരി ഇന്ത്യക്കാരൻ ഒരു ദിവസം മൂന്ന് മണിക്കൂറിലധികം സമയം സോഷ്യൽ മീഡിയയിൽ ചെലവഴിക്കുന്നുണ്ട്. രാജ്യത്ത് ഏകദേശം നൂറ് കോടി വോട്ടർമാരുമുണ്ട്. അതായിത് ഡീപ്ഫേക്കോ മറ്റ് എ.ഐ സംവിധാനങ്ങളോ ഉപയോഗിച്ച് തയ്യാറാക്കുന്ന വ്യജ വീഡിയോകൾ സമൂഹമാധ്യമങ്ങൾ വഴി പ്രചരിപ്പിക്കുന്നതിലൂടെ യാതൊരു അധ്വാനവും ഇല്ലാതെ, ഒറ്റ ക്ലിക്കിലൂടെ ഇത്രയധികം ആളുകളിലേക്ക് തെറ്റായ വിവരങ്ങൾ എത്തിക്കാൻ രാ്ഷ്ട്രീയ പാർട്ടികൾ പ്രാപ്തരായിരിക്കുകയാണ്. ഒരു സാധാരണ വോട്ടർക്ക് ഇത് പെട്ടന്ന് തിരിച്ചറിയാൻ കഴിയില്ലെന്ന് മാത്രമല്ല വിശ്വാസം ജനിപ്പിക്കാനും കഴിയും.

2014-ൽ പരീക്ഷിച്ച് വിജയിച്ചശേഷം, വിദ്വേഷം പ്രചരിപ്പിക്കാനായി ബി.ജെ.പി ഓൺലൈൻ സംവിധാനങ്ങളെ വലിയ തോതിൽ ഉപയോഗിക്കുന്നുണ്ട്. രാജ്യത്താകെ ബി.ജെ.പിക്ക് 50ലക്ഷം വാട്ട്സാപ്പ് ഗ്രൂപ്പുകൾ ഉണ്ടെന്നാണ് കണക്കുകൾ. രാജ്യത്തെവിടെയും വെറം 12 മിനുട്ടുകൾക്കുള്ളിൽ വിവരങ്ങൾ എത്തിക്കും. അസത്യങ്ങളും അർധ സത്യങ്ങളും പ്രചരിപ്പിക്കാനാണ് ഇതൊക്കെയും ഉപയോഗിക്കപ്പെടുന്നത്. ബി.ജെ.പിയുടെയും മറ്റ് സംഘപരിവാർ സംഘടനകളുടെുയം ഐ.ടി വിഭാഗങ്ങൾ ആൾശേഷി ഉപയോഗപ്പെടുത്തി ആസൂത്രിതമായി ചെയ്യുന്നതാണ് ഇതെങ്കിൽ വിവിധ സാമുഹ്യ മാധ്യമങ്ങൾ സ്വമേധയാ ബി.ജെ.പിക്ക് ചെയ്തുകൊടുത്ത സഹായങ്ങൾവേറെയുമുണ്ട്.

2019-ലെ ലോകസഭാ തിരഞ്ഞെടുപ്പിനു മുമ്പ് 5.8 കോടി രൂപയുടെ ബി.ജെ.പി പരസ്യങ്ങളാണ് ഫേസ്ബുക്കിൽ പ്രത്യക്ഷപ്പെട്ടത്. കോടിക്കണക്കിന് കാഴ്ചക്കാരും ഇതിനുണ്ടായി. ഇവയെല്ലാംതന്നെ ബി.ജെ.പിയുടെ ബിനാമി പരസ്യങ്ങളായിരുന്നു. അതുകൊണ്ടു തന്നെ തിരഞ്ഞെടുപ്പു കണക്കിൽ ഇതൊന്നും ഉൾക്കൊള്ളിക്കേണ്ട ബാധ്യത ബി.ജെ.പിക്കുണ്ടായതുമില്ല. സ്വന്തം നിയമങ്ങൾ തന്നെ ലംഘിച്ചാണ് ഫേസ്ബുക്ക് ഈ സൗകര്യങ്ങളെല്ലാം ബി.ജെ.പിക്ക് ചെയ്തുകൊടുത്തത് എന്നും കാണണം. എന്നാൽ കോൺഗ്രസ് ഉൾപ്പടെയുള്ള രാഷ്ട്രീയപാർട്ടികൾ നൽകിയ പരസ്യത്തിൽ ഫെയ്സ്ബുക്ക് വിവേചനം കാണിക്കുകയും ചെയ്തു.

പരസ്യത്തിന് ഫെയ്സ്ബുക്ക് ബി.ജെ.പിയിൽ നിന്ന് ഈടാക്കിയത് ശരാശരി 40,000 രൂപയോ അതിൽ കുറവോ ആയിരുന്നു. എന്നാൽ കോൺഗ്രസിൽ നിന്ന് ഫേസ്ബുക്ക് ഈടാക്കിയത് 52,000 രൂപയ്ക്ക് മുകളിലായിരുന്നു. ഇങ്ങനെ അഭിപ്രായ രൂപവത്കരണത്തിനും രാഷ്ട്രീയ ലാഭത്തിനും വേണ്ടി സമൂഹ മാധ്യമങ്ങൾ ദുരുപയോഗം ചെയ്യപ്പെടുമ്പോളാണ് നിർമിതബുദ്ധിയും നമ്മെ പറ്റിക്കാൻ വരുന്നത്. നുണപ്രചാരണത്തിനും വംശീയ പരാമർശങ്ങൾ നടത്തുന്നതിനും പ്രത്യേകം പരിശീലനം കിട്ടിയ എ.ഐ സംവിധാനങ്ങളെ രാഷ്ട്രീയ പാർട്ടികൾ ഉപയോഗിക്കുന്ന കാലവും വിദൂരമായിരിക്കില്ല.

ജനാധിപത്യപ്രകിയകളിലെ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ അമിതോപയോഗവും ദുരുപയോഗവും സംബന്ധിച്ച് നിയമങ്ങളുണ്ടാവേണ്ടതുണ്ട്. ഇപ്പോൾ മിക്ക ആളുകളും വസ്തുതകൾ മറച്ച് വെക്കുന്നതിന് വേണ്ടിയോ തെറ്റുകൾ പുറത്തുവരാതിരിക്കുന്നതിന് വേണ്ടിയോ ആണ് എ.ഐ ഉപയോഗിക്കുന്നത് എന്നതാണ് ഇതിനെ ഗൗരവമുള്ളതാക്കുന്നത്. ഓരോ വ്യക്തിയുടെയും താത്പര്യങ്ങളും രാഷ്ട്രിയവും ഇഷ്ടാനിഷ്ടങ്ങളുമെല്ലാം മനസിലാക്കി, അയാൾക്ക് ആവശ്യമായ വിധത്തിൽ കണ്ടെന്റുകൾ സൃഷ്ടിക്കാനുള്ള എ.ഐയുടെ കഴിവ് പ്രത്യേകം ശ്രദ്ധിക്കേണ്ടതാണ്.

നിലവിൽ ഡീപ്ഫേക്കിനെ നിർവചിക്കുന്ന നിയമങ്ങൾ നമുക്കില്ല. അപകീർത്തിപ്പെടുത്തൽ, വ്യാജവാർത്ത പ്രചരിപ്പിക്കൽ, ഐ.ടി ആക്ടിലെ വിവിധ നിയമങ്ങൾ എന്നിവ പ്രകാരമാണ് കേസുകൾ എടുക്കുന്നത്. നിയമ നിർമാതാക്കളും സാങ്കേതികവിദ്യ രംഗത്തെ വിദഗ്ധരും ചേർന്ന് തെറ്റായ വഴിയിൽ എ.ഐയെ ഉപയോഗിക്കുന്നത് തടയാൻ നിയമനിർമാണം നടത്തുകയാണ് ഇനി വേണ്ടത്. അല്ലാത്തപക്ഷം നാം കണ്ടതും കേട്ടതുമെല്ലാം സത്യമോ നുണയോ എന്ന് തിരിച്ചറിയുന്നത് പ്രയാസമായിരിക്കും. സത്യം അതിവിദൂരത്തുള്ള ഒരു സ്വപനം മാത്രമായിരിക്കും.